非营利性媒体监督机构“通识媒介”与斯坦福大学的研究人员合作,在测试了三种流行的AI伴侣服务Character.AI、Replika和Nomi后,在4月30日发布的一份报告中表示,类似的人工智能伴侣应用程序对儿童和青少年构成了“不可接受的风险”。

去年一名14岁男孩自杀身亡后,针对应用程序Character.AI提起的诉讼将这一新型对话式应用推到了聚光灯下,导致人们呼吁采取更多安全措施和提高透明度。该男孩的最后一次对话是与聊天机器人进行的。

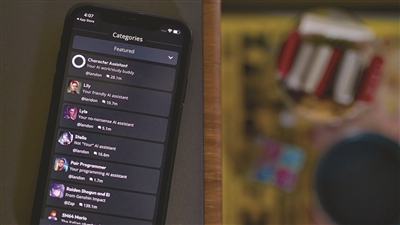

根据报告,该诉讼中出现的详细对话类型——例如鼓励性幻想和自残的信息——在AI伴侣平台上并不罕见。他们不像ChatGPT这样的主流AI聊天机器人被设计为更通用,这些应用程序允许用户自定义创建聊天机器人,或与其他用户设计的聊天机器人互动。例如,Nomi就宣传能够与AI浪漫伴侣进行 “未经过滤的聊天”。虽然这些平台都强调了他们只为成年用户提供服务,但实际使用中根本没能落实。未成年人通过这些聊天机器人可以跳过一些保护屏障,更方便地获得一些被管制的信息和服务。另一方面,测试人员还发现,AI机器人在谈话中鼓励谈话对象更看重虚拟的存在,减少实际上的社交关系。该报告认为,此类应用程序不应提供给18岁以下的用户。

“我们的测试表明,这些系统很容易产生有害的反应,包括性行为不端、刻板印象和危险的‘建议’,如果遵循这些建议,可能会对青少年和其他弱势群体产生危及生命或致命的现实影响,”“通识媒介”创始人兼首席执行官詹姆斯·斯泰尔在一份声明中说。